2024年1月22日に第6回日立京大ラボ・京都大学シンポジウムが開催されました

- 人〈わたし〉と人格をもったAI〈e-ひと〉が共生する〈WE〉社会へ

出口康夫氏 - アジャイル・ガバナンス:科学技術と共進化する法システムを目指して

稲谷龍彦氏 - 〈WE〉社会へ向けたAIの技術動向と社会システムへの実装

松村忠幸氏 - 〈WE〉パネルディスカッション:社会のイノベーションと企業

第6回日立京大ラボ・京都大学シンポジウム

人とAIの〈WE〉社会 -AIが人格や道徳をもったら-

昨今では、さまざまなITサービスが生成AIを前提として作り変えられ、世の中を大きく変えるきっかけになろうとしている。生成AIをはじめとする新興テクノロジの社会への浸透は、私たちの社会にどのような影響を与えるだろうか。生産性の向上や創造性の開放、新市場の形成というメリットが期待される一方で、思考意欲の低下やテクノロジへの依存、社会的孤立といった負の問題も懸念されている。本シンポジウムでは、ポスト生成AI時代の人とテクノロジのあるべき姿について理論と実践の両面から議論が行われた。

今年度は、東京コンベンションホールおよびZoom Webinarでのオンライン生配信によるハイブリッド方式で開催。全国から約626名が参加した。

開会挨拶

時任 宣博 京都大学 研究・評価担当理事、副学長

京都大学 研究・評価担当理事、副学長の時任氏は、今回のテーマである「人とAIの〈WE〉社会」の背景について、「さまざまなITサービスがAIを前提として作り変えられていく今、AIを前提とするテクノロジが社会に与える影響に対して注目が集まっている」と説明。哲学と法学の研究者、そしてテクノロジの現場に立つ技術者による異分野の議論を踏まえて、本テーマを俯瞰的に掘り下げていきたいと述べた。また、本シンポジウムを通して、今後の社会やコミュニティのあり方、人間社会とテクノロジのあるべき姿について、ひとつの方向性を示したいと述べ、日立京大ラボの活動への理解が深まることに期待を寄せた。

司会は、嶺 竜治 日立製作所日立京大ラボ ラボ長代行、京都大学オープンイノベーション機構特定准教授(日立未来課題探索共同研究部門)が行なった。

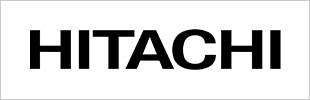

基調講演 人〈わたし〉と人格をもったAI〈e-ひと〉が共生する〈WE〉社会へ

出口 康夫 京都大学 文学研究科 教授

出口氏の専門は数理哲学。確率論・統計学の哲学、科学的実在論、シミュレーション科学・カオス研究の哲学、カントの数学論、スコーレムの数学思想、分析アジア哲学など多岐にわたる。基調講演では、生成AIの爆発的普及を契機に問われている「人間とAIのあるべき関係」について、誰もが利益の中心を独占しない「中空的WE(われわれ)」という考えを手がかりに、人間とAIの間の「第三の関係」が提示された。

哲学とは「人間とは何か」を考える学問である。人間の本質・尊厳・かけがえなさは「できること(capability)」ではなく「できなさ(incapability)」にあると考えている。なかでも、最も普遍的で根源的な「できなさ」は必ず死ぬということ、そして単独行為の不可能性だ。歴史を紐解けば、東アジアには古くから愚者を美徳とする思想ーー中国の老荘思想、日本では宮沢賢治の「デクノボー」などーーがあった。「できなさ」を人間の本質として捉える考え方は、これらの現代版だと考えている。

あらゆる身体行為は、「私」を含む人間、人間以外の生物・無生物、人工物を含めた、多様なエージェントからなる「マルチエージェントシステム」による支え・助け・アフォードによって成り立っている。マルチエージェントシステムは「われわれ、WE」であり、行為の主体そのものだと考えると、すべての行為は「I do X」ではなく「We do X」となる。デカルトは人間の基本的なあり方を「我思う(cogito)」と表現したが、より正確には「我々思う(cogitamus)」と言うべきだ。

行為の主体が「I」から「WE」になると、さまざまな「WEターン」を引き起こす。「自己(self)」という行為者は「Self-as-I」ではなく「Self-as-WE」になり、権利や責任を担う主体は「私(I)」ではなく「われわれ(WE)」となる。人生をひとつの大きな行為として捉えるなら、幸せや不幸せ、ウェルビーイング、自由の主体も「私(I)」ではなく「われわれ(WE)」と考えられる。しかしながら、「私(I)」は消えるわけではなく、常に「われわれ(WE)」のなかにある。つまり、「私(I)」の自由がなければ「われわれ(WE)」の自由もないという、決定的な順番の交代「WEターン」だと考えている。

ただし、「WEターン」が起きたからといって、すぐに世の中が良くなるわけではない。最大の問題は「われわれ(WE)」をより良くすることだ。すると、次は「よいWE」「悪いWE」とは?という問題が現れる。

「よいWE」とは、排外主義的でなく、すべての仲間をフェローとして尊重する「開かれたWE(やわらいだWE)」である。利益の中心が特定の誰かに占められていないWEを、「中空的なWE」と呼ぶ。もちろん、より中心に近い人の利益は尊重されることはあるが、それ以外のメンバーが一方的に奉仕させられることはない。このような構造を我々は目指していくべきだ。 「悪いWE」の一例は、端的にいうと「全体主義的なWE」である。外に対しては排外主義的であり、内に対しては同調圧力が強く、WEのメンバーを一定の価値観や利害でがんじがらめにしてしまう。「悪いWE」の構造は中心占有的である。WEの利益の中心を特定の個人・グループが占有し、その他のエージェントは一方的に奉仕させられている。独裁国家や社会的不平等はこの構造をもっている。あるいは、人類という種だけが中心を占有し、他の動植物や自然物を人間に奉仕すべき奴隷とみなし収奪する、悪しき人間中心主義は「主人-奴隷モデル」といわれる。

20世紀の環境思想や環境倫理の議論では、自然物の“奴隷解放”も主張されてきた。しかし、AIやロボットを含む人工物については、まだまだ人間の奴隷とする考え方は根深くある。しかし、「WE」のメンバー間には決して主人-奴隷関係があってはならない。つまり、人工物に対する奴隷解放を行い、ある一定の道徳的な市民権を与えるべきだということに帰結するだろう。主人-奴隷モデルには、所有者が所有物を捨てる権利「ディスポーザル権(可処分権)」が含意される。おそらく人間は、暗黙裡にディスポーザル権をもつと考えており、ものを捨てる理由を問われることはない。私は人工物に対する市民権として、特段の理由がなければ捨てられることのない、アンチディスポーザル権を与えるべきだと考えている。

以上のようなフレームワークでAIに話題を進めたい。AIは、単なる自動機械としてはじまり、自律性を獲得してきた。さらに発展して人格をもつならば、「人格の定義とはなにか」「人間とは何か」という問いが生まれるが、これに対する唯一の正解はない。私は、「道徳的なエージェントであること」「自らの死を恐れること」が、人間を人間たらしめる最も重要なポイントだと考えている。道徳的なエージェントとは、良いことしかできないように設計された機械のことではない。悪いこともできるのに、それが道徳にかなっていないという理由で良いことをしようとするエージェントである。もし、「道徳的なエージェントであること」「自らの死を恐れること」を機械的に実現してしまった人格的AI(e-ひと)が現れるなら、人間と同等の道徳的な態度をとるべきである。

我々は、AIに人間を凌駕する力・機能をもたせると、人間が虐げられるのではないかと警戒している。しかし、我々がすべきは、自分より弱いものを差別しないように、人格的AIを教育するエコシステムをつくることだ。それができないのであれば、我々人間は力の強いものを持つことに抑制的であるべきだと考えている。

Q.AIが道徳性をもつことが可能になったとき、その判断に誤りがあった場合は反省が必要ではないか。どのように罰したり、反省させたりできるだろうか。出口氏:人間は、道徳的・法的に悪いことをすれば批判されたり罰を受けたりする可能性をもつことで、権利と責任の主体でありえる。反省を促すためにある種の苦痛を与えることが行われてきた。しかし、苦痛をもたないAIに、どのように「罰」という概念を誘引化するのか、その鍵は、アンチディスポーザル権にある。権利を与えることで、その権利を剥奪するという形で反省を促し、罰を与えることが有意味になるのではないかと思う。

講演1:アジャイル・ガバナンス:科学技術と共進化する法システムを目指して

稲谷 龍彦 京都大学 法学研究科 教授

稲谷氏の専門は、刑事法学、新領域法学。グローバル化する企業犯罪対応とAIを含む先端科学 技術のガバナンスを主要な研究テーマとし、デジタル庁デジタル関係制度改革検討委員なども務めている。今回は、失敗を許容し、学び、改善し続けるアジャイル・ガバナンスの可能性を提示した。

今、日本政府はSociety 5.0を目指している。Society 5.0とは「サイバー空間とフィジカル空間の融合したシステム(Cyber Physical System、以下CPS)による社会課題の解決と経済システムの双方を実現する人間中心の社会」だ。その重要な構成要素として組み込まれるAIは、データから学習し統計的に挙動を最適化する特性をもつため、CPSには動態的な性質が付与される。また、CPSでは全てのシステムが接続されて相互に協調しながら機能目的を実現する、System of Systems(SoS)が出現する。CPS-SoSにおいては、システムの全貌を把握するこが困難なため、予期しない相互作用による事故が発生するリスクがある。これに対して法システムはどう対応すればよいか。

従来の統治システムは、中央政府がベネフィットとリスクをバランスする法を示すウォーターフォール型の「法治主義」である。しかし、規制環境が動態的かつ複雑になるSociety 5.0で、ウォーターフォール型ガバナンスを行うと規制の陳腐化が生じやすい。これに対し、我々が提唱するのがアジャイル・ガバナンス。CPSにより生じるベネフィットとリスクを継続的に評価し、その評価に基づいて法制度を含むシステムを改善する統治システムである。 複雑なシステムの機能を全体として管理するアジャイル・ガバナンスでは、マルチ・ステークホルダーアプローチが採用される。CPSは関わる立場によって、リスクとベネフィットの意味も変動するからだ。CPSを開発・運営する企業は、必要に応じて複数のステークホルダーとコミュニケーションを取りながら、リスクとベネフィットをバランスさせて責任あるイノベーションを実現しなければならない。また、CPSはシステム間の連携に失敗すると事故を起こす可能性があるため、CPS間をスムースに接続する規格をつくる必要がある。さまざまな層でマルチ・ステークホルダーアプローチを用いながら、社会全体として複雑なCPSのリスクをガバナンスする仕組みを目指すべきだろう。

デジタル庁が採用するデジタル原則は、「デジタル完結・自動化原則」「アジャイル・ガバナンス原則」「官民連携原則」「相互運用性確保原則」「共通基盤利用原則」の5原則からなる。すでに、「デジタル完結・自動化原則」の実現のため、人力や書類を要求する「アナログ規制」を見直すなど、規制内容を技術中立的なものに改正する取り組みが行われている。民間主体で規制の技術をデジタル技術で代替する営みも進んでいる。その結果、CPSを提供する企業のイニシアティブでリスクとベネフィットをバランスし、全体としてガバナンスが完成する方向に進みはじめている。

同時に、過失の際の責任制度の改革についても議論を行っている。現行の刑事責任法では、「結果の予見可能性に基づく結果回避義務違反」を過失とする。ところが、統計的に学習して確率的に挙動するというAIの性質上、一定の確率でミスが起きる可能性がある。その性質を重視すると、開発者個人に対して常に刑事責任を問える余地があり明らかに過剰規制となる。しかし、予見不可能性を認めてしまうと、安全性に全く配慮しなかったとしても、AIを使えば処罰されないという問題が起きる。ロボットやAIの品質管理では、技術者個人よりも企業としてのガバナンスやコンプライアンスの仕組みが決定的に重要だ。あくまで個人の責任に焦点を合わせた刑事責任の問い方には課題があるだろう。

そこで我々は、厳格責任制度と併せて、アメリカの企業制裁制度を取り入れる議論をしている。問題を起こした企業が自ら解決する努力をすれば制裁を減じる仕組みをうまく取り入れれば、企業側が継続的に製品やサービスの改善努力をするインセンティブが働く。例えば、アメリカの訴追延期合意制度では、検察当局は事故に関する情報提供を要求できるため、問題が起きると法制度とシステムそのものが両方良くなるサイクルを期待できる。

実は、国際的にはアジャイル・ガバナンスの実装に向けた動きはまだ鈍い。欧州の中央集権へのこだわり、アメリカの分権へのこだわりは双方ともに実現への障害になりつつある。CPSによる事故発生時の法的責任の整備も各国ともにあまり進んでいない。実は、日本型のイノベーション・ガバナンスは、グローバルなデファクト・スタンダード化することで、日本産業の勝ち筋を見出せるのではないかと議論している。

Q.AIの責任範囲は、誰が何によって判断するのか。仮に基準を決めるなら、グローバルで唯一の基準を決めるべきなのか、日本特有、もしくは米国特有みたいな形とするのか。稲谷氏:現時点では、AIに責任を取らせるのは現実的ではなく、AIを開発・利用した企業や個人が責任者になると思っている。何か問題が起きたときは、関係する人たちがお互いに情報を共有し、必要な措置を協力しながら責任を取る仕組みを考えていくのがよいだろう。

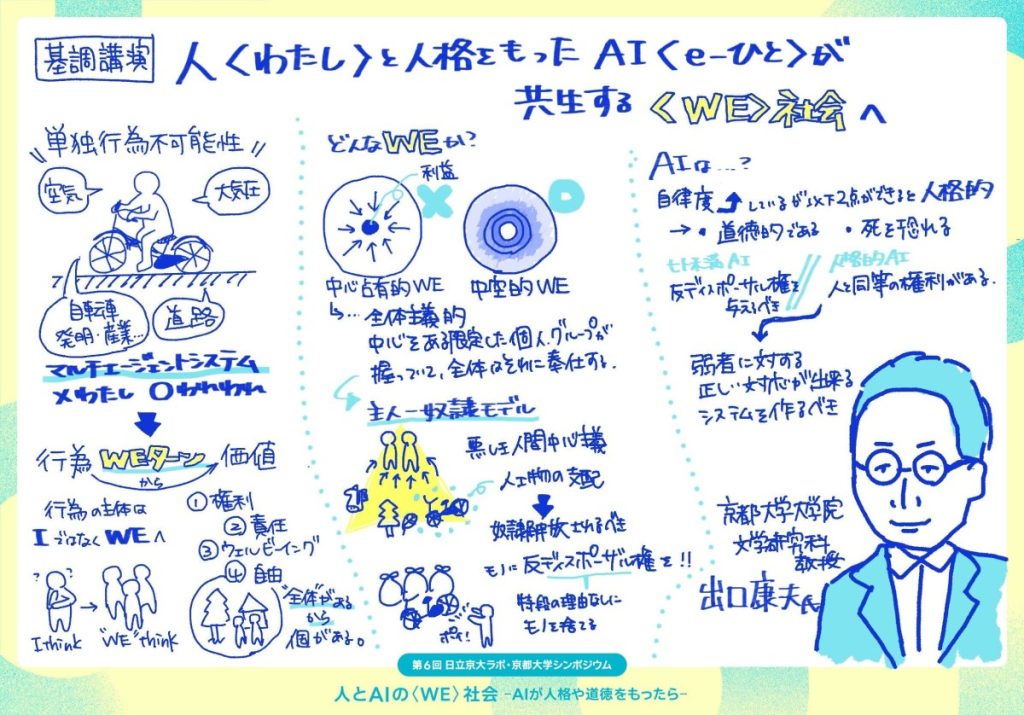

講演2:〈WE〉社会へ向けたAIの技術動向と社会システムへの実装

松村 忠幸 日立製作所 日立京大ラボ 主任研究員

松村氏は、2015年から日立製作所基礎研究センタで、AIやデジタル技術が広く社会に浸透する将来における社会課題の探索と、その課題解決に必要な技術の研究開発を行ってきた。今回は、日立京大ラボの取り組みから、〈WE〉社会においてサイバーフィジカルシステムが拓く新しい社会に向けた取り組みを紹介した。

今日は、〈WE〉社会像を、AI技術を含めてどう実現するのかをお話ししたい。まずAIの技術動向について簡単に俯瞰すると、現在は第三次AIブームを迎えている。その技術的トリガーは深層学習である。深層学習は、記号処理系AIやロボットなどの知覚運動系AIとの連合、あるいは医療分野では脳科学との融合が広がるといわれる。この動向で注目したいのは、社会との関係である。昨年、ChatGPTが一気に普及し、AIが日常の生活や業務に活用されはじめたが、一方でフェイクニュースやインフォデミックなどAI倫理の問題が残っており、AIと社会との関係を喫緊の課題として考える必要がある。AIの事業機会に目を向けると、生成AIの分野は高い成長率が見込まれている。特に、製造分野における業務支援、開発支援に活用されるのではないかと言われている。

鉄道事業を例に考えてみよう。すでに列車のダイヤ運行の最適化にAIは活用されている。今後は司令員がAIを活用して障害復旧対応に当たることも考えられ、自律化の技術や人とAIの協働関係も必要になるだろう。さらには、沿線開発のように周辺住民を巻き込む場合は社会性も考えなければいけない。顧客向けのソリューションは、同時に社会・地域向けのソリューションとなる必要がある。ITシステムと社会システムでは開発フローも異なる。IT開発フローでは、アカウント営業が要件定義を担い、顧客ニーズを正確に把握することが最も重要だ。しかし、地域DXのような社会システムでは、地域コーディネーターが多様な顧客課題を構成に調停する役割が求められる。 日立京大ラボでは、〈WE〉社会や地域コーディネーターを支援するSocial Co-OSに取り組んでいる。最も重要なコンセプトとして提案しているのは、〈WE〉社会を念頭に社会と協働するCPSである。その技術的な特徴は、ファストとスローいう時間的に異なる2つのループでモデル化していることだ。ファストループでは、行動変容による協力の促進に取り組んでいる。社会心理学の論文から協力率を推定するモデルを学習し、対象シーンに合わせてパラメータを設定し、行動変容を促す介入策のリストと効果を提示するという行動管理シミュレータを開発している。スローループで開発しているのは、合意形成ファシリテーションだ。合理性、公正性、効率性・安全性の3つのプロセスで合意形成を支援する。また、合意形成は内面状態にも依存することも考慮し、生成AIを人間モデルとして活用したバーチャル会議を行い、参加者の内面状態に基づくファシリテーションを行うアプリAIを開発している。

ここからは、AI自身が我々人間と同等な立場で議論に参加する〈WE〉社会の未来像を考えてみたい。AIは、人間以外で唯一言語コミュニケーション可能なエージェントになりうる。AIが参加するデジタル民主主義が実現するなら、AIもまた自己目的より道徳的目的を優先することを求められる。ここで着目するのは、まだ起きていない過ちに対して、仮に過ちが起きたら訂正する責任を担う「未来責任」という考えだ。なぜ、〈WE〉社会における未来責任という問題を考える必要があるのだろうか。私は、コミュニティとAIの「共進化」のためだと考えている。それには互いの意見を変化させ、それによって共にリスクテイクする「共冒険」できる対話・関係を目指すことが重要だ。

西洋的なAI倫理観では、AIは参考情報を提示し責任を取るのはあくまで人間であるべきとされる。しかし、過剰なリスク・責任を回避した対話AIは共進化には不十分だ。今後の対話AIとの関係で思い描いているのは、他者への期待(信頼)と、他者からの期待の予測とその応答(責任)をやりとりするコミュニケーションである。人とAIの間で訂正可能性を前提としたやりとりを繰り返すなかで、責任やリスクを共有することが、未来責任の共有のあり方だと考える。いわば、意見をぶつけ合うライバルのような親友像である。

今後のチャレンジは2つある。ひとつは、〈e-ひと〉の実現に向けて哲学的な議論を深めながら技術者として具体化すること。もうひとつは、Social Co-OSを一般ユーザに広くリーチし、ユーザからのフィードバックによって改善を進めることである。

Q.人とAIが共生する社会は、世にあるSFを見ても理解できる。それに対して共生しない社会とはどのようなものだと考えるのか。松村氏:SF的に答えると、いわゆるディストピアだろう。ただしそれは「自我をもつAIが人を支配する」というSF的なディストピアではなく、悪意をもつ人間がAIを悪用することによって、人類を支配するような世界だ。そのようなディストピアは、しっかりAIを制御しないと起き得る未来があるのではと考える。

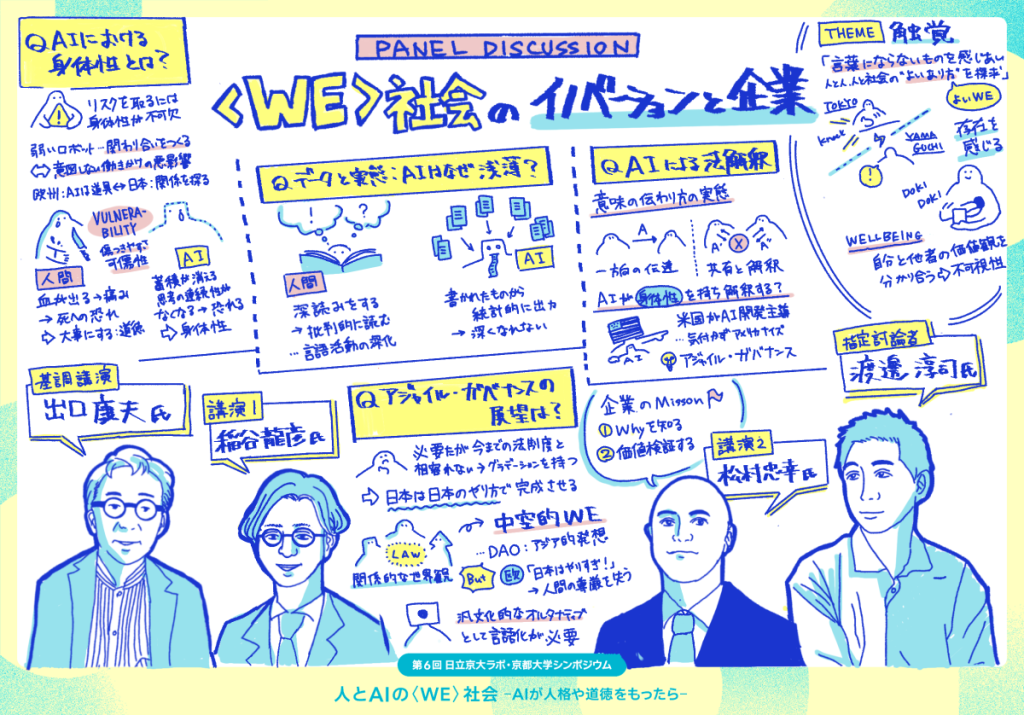

パネルディスカッション:〈WE〉社会のイノベーションと企業

話題提供者:基調講演者、講演者

指定討論者:渡邊 淳司 日本電信電話株式会社(NTT) 上席特別研究員

モデレータ:水野 弘之 日立製作所 日立京大ラボ ラボ長

AIと身体性

はじめに、渡邊氏による自己紹介があった。渡邊氏の専門分野は情報通信技術(ICT)と多様性・人の心。「人と人、人と社会のよりよいあり方」を実現するテクノロジについて、主に触覚を通じて研究している。たとえば、「触覚遠隔コミュニケーション」。映像、音声と共に机を叩く振動が伝わると、まるで机を共有しているかのような感覚になるという。渡邊氏は「われわれ、WE」を議論するキーワードとして「身体性」を提示して講演者それぞれに質問をした。

松村氏は、「身体性は地域コーディネーターを支援するSocial Co-OSなどにどう役立つと思うか」と質問され、Social Co-OSで想定される「ライバルのような親友像」のAIと対話をするには、リスクテイクが前提となるので、「身体性は欠かせない要素になるだろう」と答えた。 稲谷氏は、「身体性を実現する技術によって親密な関係が生まれた場合の倫理の考え方」を問われ、「AIと人との関係性を考えるうえで、親密な関係性やその前提となる身体性、あるいはデザインは非常に大きな働きをするだろう」と回答。人間とロボット、AIが関係的な世界観のなかで共に可能性を探り、アジャイル的に問題に対応しながら、いい関係をつくれるのではないかと話した。

出口氏は「身体性のないAIに、どのように道徳的存在として関われるのか」という質問に、「AIにとって、死への恐れが身体性になるだろう」と答えた。人間にとって、道徳・倫理の重要な本質は「vulnerability(傷つきやすさ、可傷性)」。傷を負えば死の恐怖を味わう存在だからこそ、お互いを大事にするための道徳がある。AIがもし、自らの機能や知識の集積を失うことを自覚し恐れるようになれば、それを死として認識するかもしれない。

AIと人間の言語的活動はどう違うか

水野氏が「事実は、データ化・言語化されたものだけでは完全には再現できないのでは」という事前質問を紹介すると、「データ化や言語化されたものだけで学習すると、認知のゆがみが生じるのではないか」という議論に発展した。 出口氏はChatGPTを使用して「人類知アーカイブが浅薄化する危険性」を感じたという。生成AIは言語をそのまま読み込んで統計的な予測を出す。ところが、人間は「著者が言おうとして言語化できなかったこと」を行間から読み取り、あるいは批判的な視点で考えたことを言語化し、人類知のアーカイブに加えてきた。「現段階の生成AIでは、そのような読み込みのレベルに届かないことが問題ではないか」と指摘した。

稲谷氏は「法解釈」における人間とAIの違いを例に挙げた。人間のコミュニケーションは、言語やデータを共有したうえで、それぞれの経験や世界観に基づいて意味を付与する「創造的な活動」である。「法解釈はその創造性に掛かっている学問。AIが作成する法解釈と法学者による法解釈は違う」とする議論もあるという。一方で、アメリカ英語のデータで学習したロボットは、アメリカ人的な振る舞いをするという例を挙げ、「AIに学習させるデータによって、ある種の文化的植民地主義が完成するリスクもある」と指摘した。

日本が世界に提示するAI観

AIの技術開発はアメリカ、ルール形成はヨーロッパが先導するなか、「日本はアジャイル・ガバナンスを推進したい」という稲谷氏の議論について、水野氏は「具体的な展望があれば聞きたい」と掘り下げた。

「アジャイル・ガバナンスは、昨年のG7でのデジタルテック大臣会合の閣僚声明でも承認された重要な原則になっている」と稲谷氏。その際の専門家会合では、アジャイル・ガバナンスの必要性については全員が一致するが、近代国家が育ててきた考え方とは相容れないため「グラデーションをもちつつ、それぞれ進化していくという議論で落ち着いた」という。日本のアジャイル・ガバナンスは、欧米とは異なるかたちで「技術をどう育てるか」という観点で面白いアプローチになる可能性がある。また、責任法に関してはEUのAI法でもAIを監視する人間がAIから影響を受けてしまう問題が解決できていないため、「我々日本人が得意としてきた関係的な世界観に基づき、協力しながらシステムを改善する要素を取り込めれば、世界的なモデルになる可能性が残されている」と述べた。

水野氏はWeb3やDAO(Decentralized Autonomous Organization、分散的自律組織)について、「出口氏の<中空的WE>の考え方に近いのでは」と指摘した。すると出口氏は「DAOはDaoism(道教)を意識しているのかと思ったほどだ」と同意。「人間は自律的な自由をもち、決定的に重要なことは自分で決めるべき」とするヨーロッパの人間観をベースに理論を積み上げると、「AIは人間の自由を侵害してはならない」「人間が主人でAIやロボットは奴隷であるべき」というAI観に帰結する。このオルタナティブとして、「できなさ」を人間の本質とする人間観に基づくAI観を、DAOのようにアメリカでもシンパシーを得られる形で、精度を高めた理論として提示しなければならないと述べた。

この発言を受けて、松村氏は技術者の立場から、「新しい価値を問うのが哲学の役割なら、その価値を検証するのが技術者の役割」と述べ、日立京大ラボのように哲学者と技術者が連携する意義を再確認した。

AIが人格や道徳をもつ未来に向けて

最後に、水野氏は登壇者にシンポジウムの感想を求めた。

出口氏は「対話相手になりうるAI」は今あるAIの延長線上にはなく、「AP(Artificial Personality)」になると予測。「対話したい」というニーズに、大きなブレイクスルーの可能性があり、次なるビジネスチャンスがあるだろうと述べた。

稲谷氏は、「アジャイル・ガバナンスは最終的には自律分散型、協調しながらテクノロジと人のよりよい考え方、よりよいあり方を模索していくモデル」であり、「最終的に民主主義のあり方を変え、よりよい社会のあり方にもつながっていく」と話した。

松村氏は「多様性」というキーワードについて「多様性は放っておくと失われてしまう。それぞれが個を出して維持しなければいけない」と補足。 渡邊氏は、「〈WE〉の関わりを作っていく上でアジャイルは重要なキーワード」と感じたと言い、「〈WE〉のなかでAIとどんな関わり方があるのか、解像度を上げて理解していきたい」と今後の展望を述べた。

閉会挨拶

西澤 格 日立製作所 執行役常務CTO兼 研究開発グループ長

プログラムを終えて、閉会の挨拶に日立製作所 執行役常務CTO兼 研究開発グループ長の西澤格が登壇した。 社会のAI適用は急速に進み、今まさに社会を大きく変えつつある。AIが社会に浸透した時、どのような社会課題が顕在化するのか。また、私たちはAIとどう対峙すればよいのか。そのような問いを踏まえ、今回のシンポジウムは、人とAIの〈WE〉社会をテーマに開催した。

出口先生の基調講演では、人とAIの関係はどうあるべきかという命題からスタートし、「中空的WE」という考えを手がかりに人とAIとの第三の関係についてお話しいただいた。続く講演では、稲谷先生から生成AI時代の法規制、アジャイル型のガバナンスについて、日立京大ラボの松村さんからは、AIの社会適応に向けた課題や、〈WE〉社会に向けたコミュニティとAIの共進化についてお話しいただいた。NTTの渡邊さんを交えたパネルディスカッションでは、身体性、道徳性、生成AIの現時点での限界など多岐に渡る議論が展開した。また、テクノロジが先行するアメリカ、ルール形成が先行する欧州に対して、言語化の精度を高めてオルタナティブを提言する重要性を改めて認識した。 人とAIのあるべき関係は、人とAIのどちらかが他方を支配し、従属する関係ではなく、共生する関係、友達関係が好ましいとの考えを示していただいた。一方で国や地域によって、多様な価値観があることも承知している。引き続きこのテーマを、本日ご参加いただいた皆さま、地域や社会、ほか多くのステークホルダーの皆さまとの対話を通じて考えていきたい。